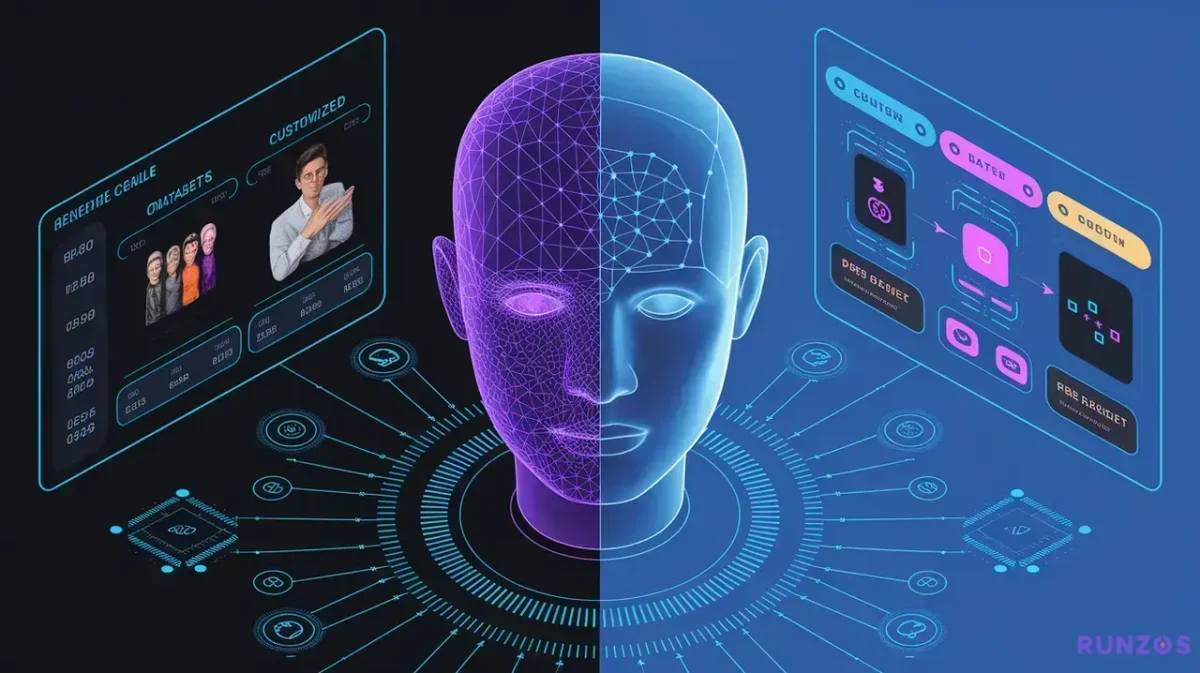

Custom Model Training: Personalize seu modelo de IA

-

Maicon Ramos

- Glossário

- 7 minutos de leitura

Navegue por tópicos

Custom Model Training (fine‑tuning), ajuste fino, é o treinamento personalizado de modelos de IA com datasets próprios para capturar estilos, personagens e manter consistência nas gerações futuras. Eu uso para adaptar o modelo ao meu domínio e à voz da marca, garantindo respostas e criações mais alinhadas sem depender de prompts extensos. Na prática, isso aumenta a consistência, reduz retrabalho e permite escalar a produção com qualidade previsível em texto, imagem ou áudio.

Por que Custom Model Training (fine‑tuning)?

Ajuste fino é a camada de personalização que faz um modelo genérico falar, criar e decidir como você precisa. Ele alinha saídas com voz de marca, estilos criativos, regras de formatação e preferências contextuais, reduzindo desvios e variações indesejadas.

O principal motivo é consistência. Ao aprender com exemplos seus, o modelo deixa de depender de prompts longos e frágeis para manter personagens, estilos e estruturas, tornando o comportamento mais previsível e repetível em produção.

Há também ganhos de precisão especializada. Em domínios específicos, o ajuste fino incorpora terminologia, padrões de resposta e critérios de qualidade que um modelo base não domina, elevando a utilidade em tarefas jurídicas, de saúde, financeiras, engenharia ou conteúdo técnico.

Na prática, isso traz eficiência operacional: menos tokens de instrução, menos retrabalho, menor necessidade de revisão humana e prazos encurtados. O resultado é um fluxo mais estável, com respostas que respeitam formato, tom e limites previamente definidos.

Outro fator é o controle. Com dados próprios, você direciona o que o modelo deve priorizar, preserva privacidade e evita expor segredos comerciais. Importante notar que o ajuste fino não transforma o modelo base em propriedade sua; ele molda o comportamento dentro das capacidades existentes.

Estratégicamente, a personalização cria diferenciação de mercado e resiliência contra mudanças de versões de modelos. Você consolida uma camada de identidade que pode ser atualizada de forma intencional, sem depender de “truques” de prompt.

Este bloco foca no porquê ajustar; não cobre requisitos de dados, etapas de preparação, custos, infraestrutura ou riscos, que são discutidos em seções próprias. Também não promete resolver limitações fundamentais do modelo base; raciocínio complexo e fatos atualizados podem exigir outras técnicas.

Uma analogia útil: é como transformar um terno de prateleira em um terno sob medida; a base é a mesma, mas os ajustes definem o caimento perfeito para o seu contexto.

Casos de uso

Casos de uso de Custom Model Training (fine‑tuning) surgem quando queremos que um modelo aprenda um estilo, um conjunto de regras ou um contexto proprietário que se repete ao longo do tempo. Em vez de instruções extensas a cada geração, o modelo passa a incorporar a “gramática” da sua marca, do seu domínio ou do seu personagem, gerando com mais precisão e menos intervenção humana.

Em conteúdo de texto, o ajuste fino é valioso para tom de voz e consistência editorial, desde microcopy de produtos até artigos longos, FAQs e scripts de atendimento. Ele também sustenta personas persistentes, mantendo características e limites de linguagem em interações prolongadas, além de adaptar respostas a jargões setoriais (saúde, jurídico, finanças) sem diluir a clareza. Em operações multilíngues, ajuda a preservar o estilo ao traduzir e localizar conteúdo em escala.

Em visuais e áudio, aplica-se ao estilo de marca para imagens (composições recorrentes, paletas e direção artística), à manutenção de personagens coerentes em campanhas e à geração de variações controladas de produtos. No áudio, pode consolidar timbre, cadência e pronúncia como assinatura sonora da marca.

Para tarefas estruturadas, é eficaz em extração e normalização de campos específicos, classificação com rótulos internos, redação de contratos e relatórios em formatos padronizados, ou geração de código seguindo convenções internas. Em compliance, ajuda a manter formulas de linguagem obrigatórias e evitar desvios que exigem retrabalho.

Em produção e operações, o modelo treinado acelera lotes de conteúdo, reduz ciclos de revisão e melhora a previsibilidade de entregas, útil em calendários editoriais, catálogos e campanhas multicanal.

Esta seção foca “onde aplicar”; não cobre requisitos de dados, pipeline técnico ou custos. Como analogia, pense no ajuste fino como ensinar um chef a cozinhar com a sua receita — ele internaliza o método, não apenas segue instruções pontuais.

Dúvidas frequentes — Custom Model Training (fine‑tuning)

Quando vale a pena optar por Custom Model Training em vez de apenas prompt engineering ou RAG?

Escolha fine‑tuning quando você precisa de comportamento consistente e repetível (voz de marca, personagens, formatos padronizados) ou de precisão em um domínio específico (jurídico, saúde, financeiro, técnico) que prompts não resolvem de forma confiável. Também faz sentido se você gera grande volume de conteúdo padrão e quer reduzir revisão humana. Para consultas pontuais, fatos frequentemente atualizados ou quando o custo inicial precisa ser baixo, comece por RAG ou prompt engineering.

Qual é o formato dos dados e qual o mínimo viável para testar a ideia?

Use JSONL (JSON Lines), onde cada linha é um exemplo com entrada e saída esperada; para chat multi‑turn inclua a sequência system/user/assistant. Como mínimo viável, experimente com ~50 exemplos muito bem trabalhados para validar a abordagem. Para resultados robustos em produção, prefira centenas a milhares de exemplos e mantenha a divisão sugerida (ex.: 80% treino / 10% validação / 10% teste).

Como devo preparar e limpar os dados para evitar problemas de qualidade e privacidade?

Remova ou anonimizar PII e dados sensíveis antes do upload. Padronize termos, corrija erros factuais, elimine duplicatas e exemplos ruidosos. Garanta que os exemplos sejam representativos do uso real e, se necessário, anote intenções ou rótulos. Adote revisão humana amostral e um fluxo de aprovação para cada lote de dados; armazene exemplos em repositório seguro e registre mudanças (versões e autorias).

Que ganhos concretos posso esperar em termos de consistência de marca e escala de produção?

Um modelo fine‑tuned reduz variação de tom e formato, exigindo prompts menores e menos revisão. Na prática isso traz: microcopy, scripts e catálogos com voz uniforme; respostas de atendimento mais alinhadas; menor retrabalho e tokens por chamada; e maior previsibilidade nas entregas em campanhas e produção em lote.

Quais são os principais riscos (overfitting, vieses, memorização) e como mitigá‑los?

Riscos: overfitting (modelo memorizando exemplos), amplificação de vieses do dataset e memorização de dados sensíveis. Mitigações práticas: usar validação/checpoints e early stopping, ajustar hiperparâmetros (menos épocas, learning rate mais baixo), auditar e balancear dados, remover PII, rodar testes adversariais e revisões humanas, e fazer rollout gradual em staging com possibilidade de rollback.

Quanto tempo costuma levar um ciclo (treino → validação → deploy) e qual o fluxo de iteração recomendado?

Depende do tamanho do dataset e do modelo: jobs pequenos podem levar minutos–horas; conjuntos maiores, horas–dias. Fluxo recomendado: preparar/dar limpeza aos dados → treinar em ambiente de teste → avaliar métricas + amostras → ajustar dados/hiperparâmetros → criar checkpoint → deploy controlado para testes → monitorar em produção e recolher novos exemplos para iterações contínuas. Use versionamento e testes A/B quando possível.

Como medir o sucesso do fine‑tuning e quando devo refinar o modelo novamente?

Meça com métricas objetivas (loss, token accuracy) e KPIs do negócio (precisão de extração, conformidade com templates, tempo de revisão) além de avaliação qualitativa (amostragem de outputs, feedback da equipe). Refaça o fine‑tuning quando o desempenho cair, a linguagem/posicionamento da marca mudar, surgirem novos casos de uso ou houver volume significativo de novos exemplos que melhorem a cobertura. Estabeleça monitoramento contínuo e thresholds que acionem a próxima iteração.